Tecnologia

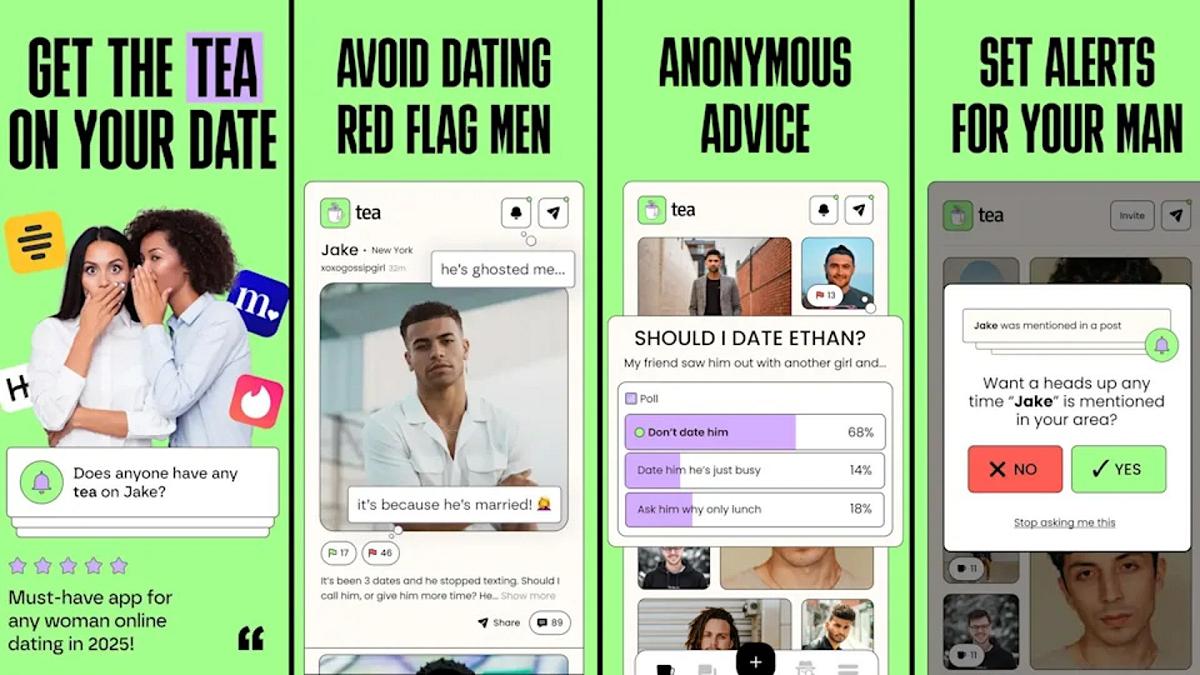

L’app che doveva proteggere le donne è finita vittima di un data breach clamoroso

DI Umberto Stentella

Tecnologia

Cina propone un’organizzazione mondiale per l’IA: “Basta monopoli tecnologici”

DI Umberto Stentella

Tecnologia

UK, selfie obbligatorio per accedere ai siti porno: scatta la verifica dell’età

DI Umberto StentellaVideo

Guarda tutti ►Scienze

Giochi

Pokémon GO entra in modalità esplosiva: attesi eventi epici e colpi di scena

DI Daniela Giannace

Scienze

I vaccini proteggono tutti: arriva una nuova prova del loro impatto sociale

DI Daniela Giannace

Scienze

Sorpresa gelida tra le bolle di Fermi: una nuova scoperta cambia la visione delle galassie

DI Daniela Giannace

Scienze

Individuato l’orario che può decidere l’esito di un esame orale all’università

DI Daniela Giannace

Scienze

Oro dal mercurio? Il piano ambizioso di una startup affascina gli scienziati

DI Daniela GiannaceTecnologia

Tecnologia

Massaggi intelligenti e capelli felici: il nuovo pettine smart Xiaomi costa meno di 70€

DI Umberto Stentella

Scienze

Pressione alta negli over 60: ecco il rimedio naturale che funziona davvero

DI Daniela Giannace

Scienze

Davvero bisogna camminare 10.000 passi al giorno? Uno studio sbugiarda il mito

DI Umberto Stentella

Tecnologia

Spotify “resuscita” gli artisti: così l’AI veniva usata per ingannare gli utenti

DI Umberto Stentella

Scienze

Scoperta una connessione geologica tra il cratere più grande d’America e il Grand Canyon

DI Daniela GiannaceGiochi

Scienze

Meno regole per i lanci di razzi nello Spazio: si rischia un Far West spaziale?

DI Umberto Stentella

Tecnologia

Meta non pagherà più gli utenti più attivi su Threads: guadagnavano 5000$ al mese

DI Umberto Stentella

Tecnologia

AI quanto mi costi: OpenAI pagherà 30 miliardi di dollari l’anno ad Oracle

DI Umberto Stentella

Scienze

Un nuovo studio lancia l’allarme sui farmaci dimagranti: scoperto un dettaglio che pochi conoscono

DI Daniela Giannace

Scienze